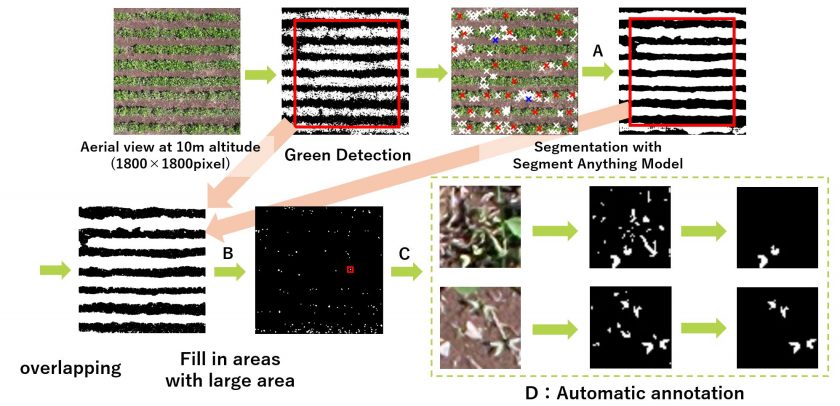

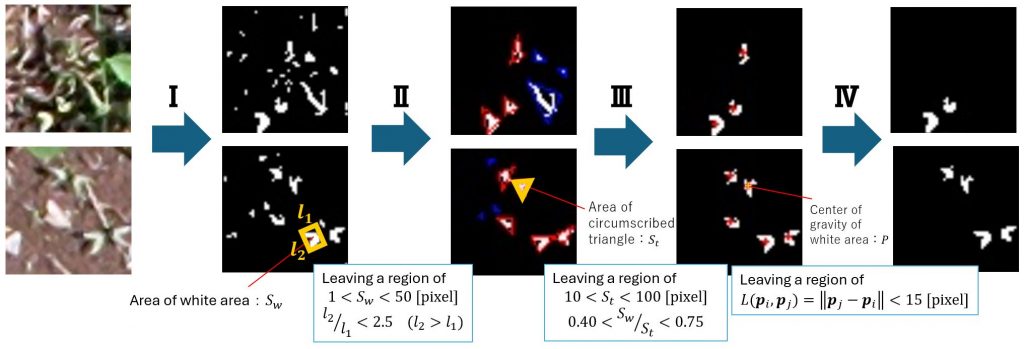

大豆圃場において,アサガオは大豆の生育に悪影響を与えます.近年,田畑の空撮画像を用いて機械学習を使い,雑草を認識する研究が進められていますが,機械学習を行うためには大量なデータを収集する必要がある上,微小な雑草データ・ラベルを収集することは困難です.また,アノテーション作業は大量の画像データを選別し,1枚ずつ色塗りする必要があり,労力がかかります.本研究では,ドローンで撮影した空撮画像から,畝の形状特徴を利用した画像処理により微小なアサガオの画像データを収集,植物の形状・色彩特徴を用いてアノテーションまでを自動化します.

実験では,手塗りでラベル付けしたデータセットと提案手法で収集したデータセットをセマンティックセグメンテーション学習モデルで比較しました.

提案手法で収集したデータセットで行った学習では手塗でラベル付けしたデータセットよりも評価が上回り,少しでも認識できたアサガオの割合は約91%となりました.

今後は,自動で行うアノテーションの精度を上げることと,新しい学習モデルを使用して学習することを目的としています.